从神话到智能体:人工智能的历史和AI Agents的诞生

AI Agents 无处不在 - 但实际上这项技术是一个站在许多巨人肩膀上的小矮人。为了避免你的脑海中对过去和现在产生巨大的断层,你可以阅读这篇人工智能发展的简史。

人工智能已经走过了一条从哲学概念到能够独立执行复杂任务的强大系统的不可思议的道路。这段历史充满了起伏和革命性的突破。让我们来一次激动人心的旅程,回顾一下人工智能发展的关键时刻,这些时刻促成了现代 AI Agents 的出现。

关于思考机器的古老梦想

创造人工智能的想法并不新鲜——它的根源可以追溯到遥远的古代。在古希腊神话中,有自动机——按照给定算法执行动作的玩偶。例如,宙斯创造的潘多拉可以被认为是第一个神话中的“人造生物”。在犹太文化中,有关于魔像的传说——用非生命物质创造并通过魔法公式赋予生命的生物,这可以被视为现代人工智能的古老原型。

后来,在 17 世纪,哲学家们开始认真思考用数学来表示人类思维的可能性。德国思想家莱布尼茨认为,人类的思想可以用特殊的符号和图表以数学方式表达——这个想法与现代人工智能的工作原理惊人地相似。

这些早期的概念,即使在当时看来很奇妙,也为未来的科学研究奠定了基础,表明创造人工智能的梦想已经伴随人类数千年。

现代人工智能的诞生:最初的步骤(1940 年代-1970 年代)

人工智能的真正历史始于 20 世纪中叶。一个转折点是 1956 年在达特茅斯举行的历史性会议,该会议奠定了这门科学的基础,并首次使用了“人工智能”一词。

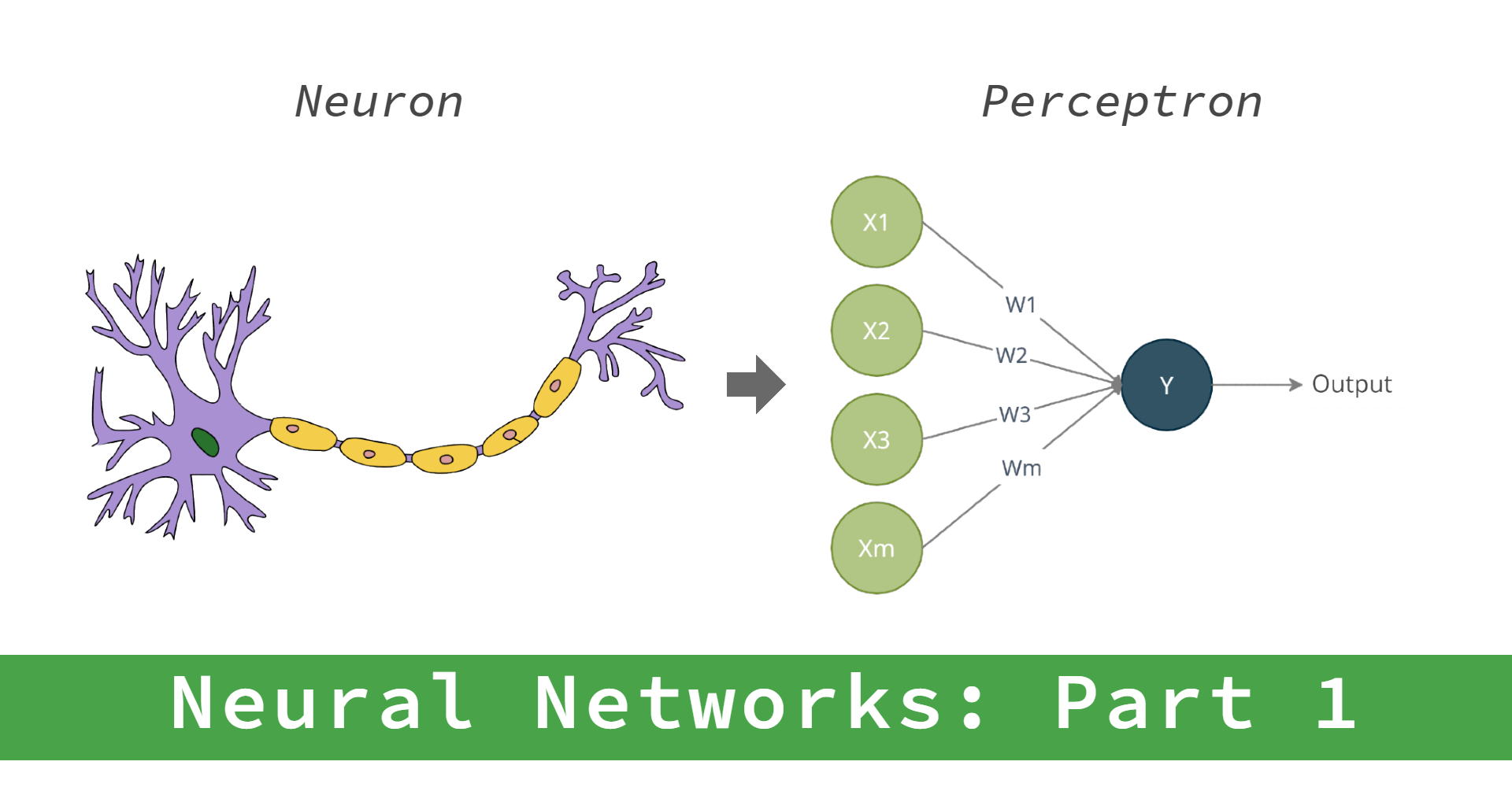

然而,甚至在此事件之前,就已经采取了重要的步骤。1944 年,芝加哥大学的研究人员沃伦·麦卡洛克和沃尔特·皮茨提出了第一个神经网络的概念模型,该模型模拟了大脑神经元的工作方式。这成为未来发展的理论基础。

真正的突破发生在 1957 年,当时康奈尔大学的心理学家弗兰克·罗森布拉特展示了第一个可训练的神经网络,称为感知器。这是一个单层系统,能够识别简单的图像并从示例中学习。尽管以今天的标准来看很原始,但感知器是一个革命性的步骤,表明有可能创建自学习系统。

起起落落:“人工智能冬天”和神经网络的复兴(1970 年代-2010 年)

人工智能的历史并非一帆风顺——热情时期被被称为“人工智能冬天”的失望所取代。计算能力的限制和理论上的困难使得实现有希望的想法成为不可能。

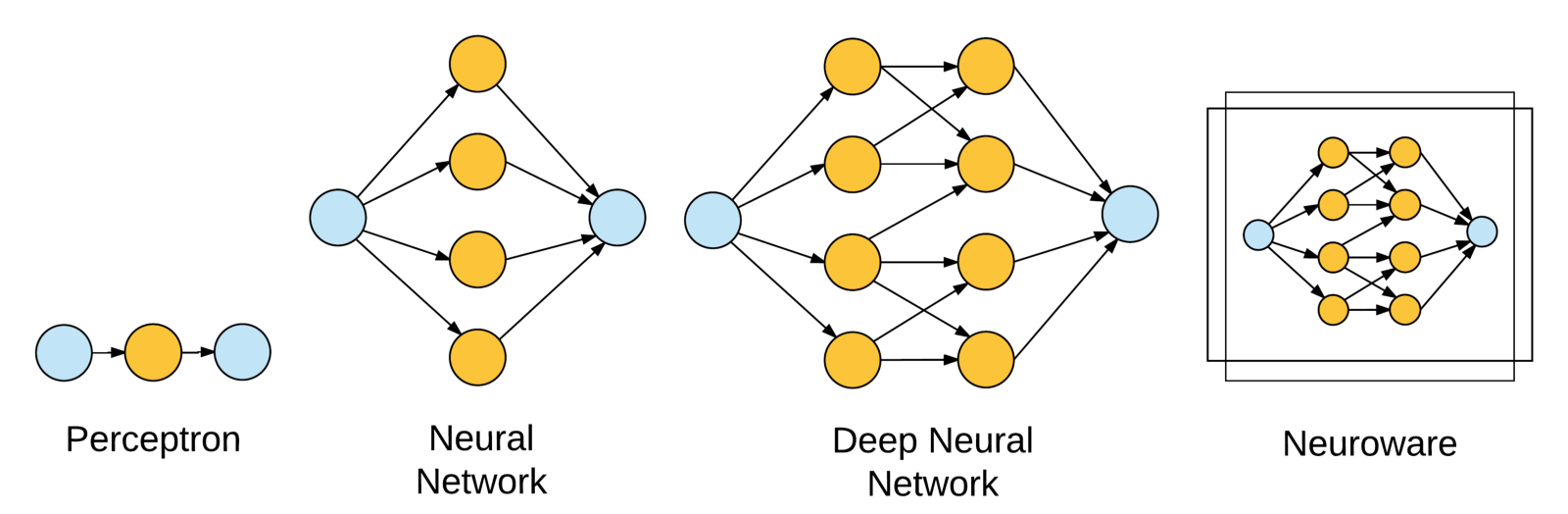

在 1980 年代,随着更强大的计算机的出现,研究人员能够开发具有两层和三层学习的神经网络。这是一个重大的进步,但真正的突破不得不等待几十年。

令人惊讶的是,深度学习的革命要归功于……电脑游戏产业!现代游戏需要复杂的计算,这导致了图形处理器 (GPU) 的开发,该处理器将数千个计算核心组合在一个芯片上。研究人员发现 GPU 架构非常适合训练神经网络。这一发现开启了人工智能发展的新纪元。

Transformer 革命:注意力改变一切 (2017)

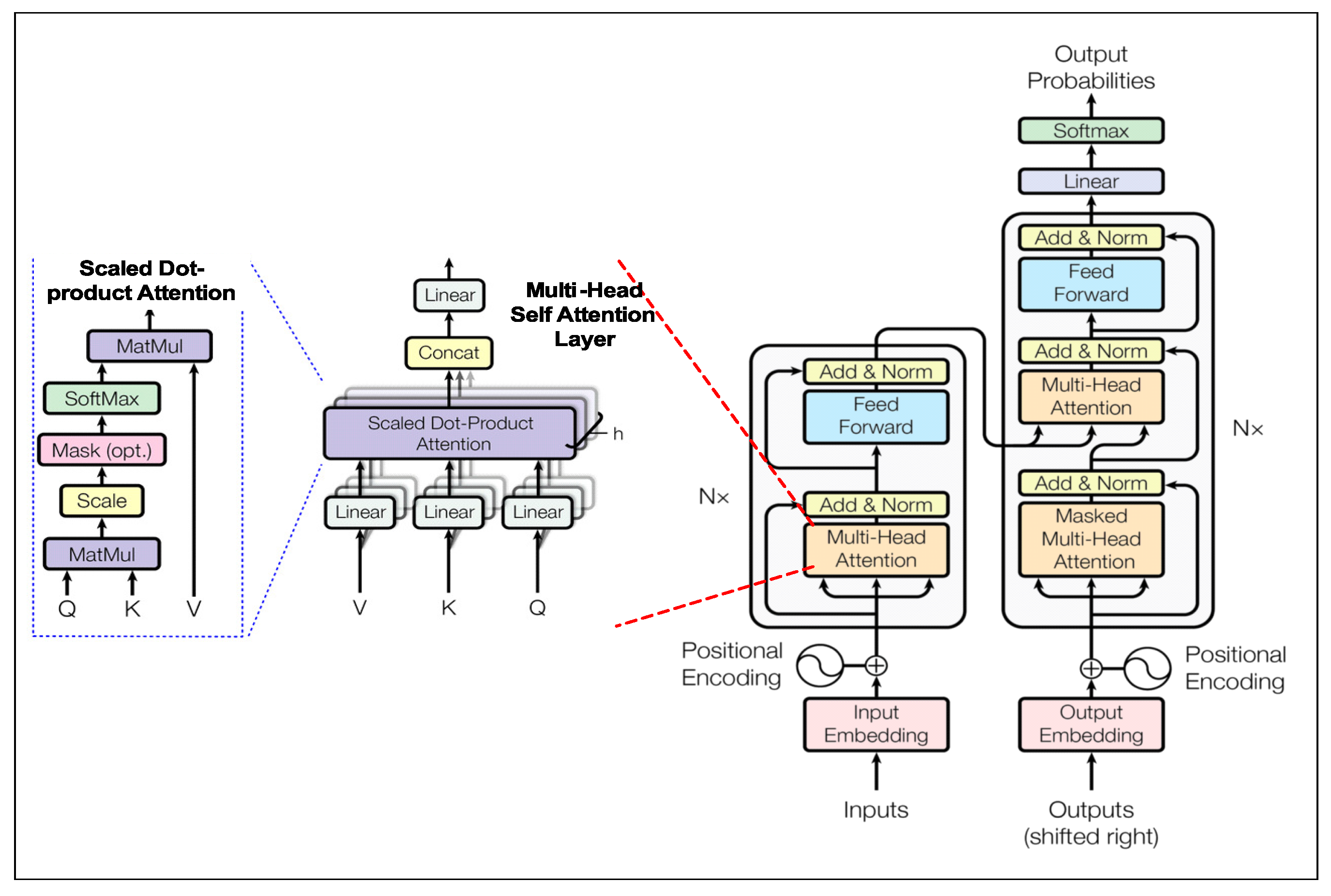

2017 年发生了一件改变人工智能格局的事件——发表了一篇题为 "Attention is All You Need" 的文章,向世界介绍了 Transformer 架构。这种基于注意力机制的架构使模型能够更好地理解数据序列中的上下文,这对于自然语言处理尤其重要。

与以前的方法不同,Transformer 可以有效地处理长单词序列,同时考虑到彼此远离的元素之间的连接。这为创建能够理解和生成与人类编写的文本无法区分的文本的模型铺平了道路。

大型语言模型的时代 (2018-2022)

在 Transformer 架构的基础上,OpenAI 研究实验室于 2018 年推出了 GPT(Generative Pre-trained Transformer)系列中的第一个模型。虽然 GPT-1 更像是一个概念验证,但它展示了生成式预训练在解决自然语言处理任务方面的潜力。

2019 年,出现了更强大的 GPT-2,引发了很多争议。它生成连贯文本的能力非常令人印象深刻,以至于 OpenAI 最初限制了对该模型完整版本的访问,担心可能被用于创建假新闻。此案例提出了关于人工智能领域伦理和安全的重要问题。

真正的革命发生在 2020 年,当时发布了 GPT-3——一个拥有 1750 亿个参数的模型。GPT-3 可以编写诗歌、创建程序代码、起草法律文件并解决许多其他任务,而无需针对每个任务进行专门训练。这一突破表明,增加模型的大小不仅会导致其能力的数量变化,还会导致其能力的质量变化。

ChatGPT:人工智能变得人人可用 (2022)

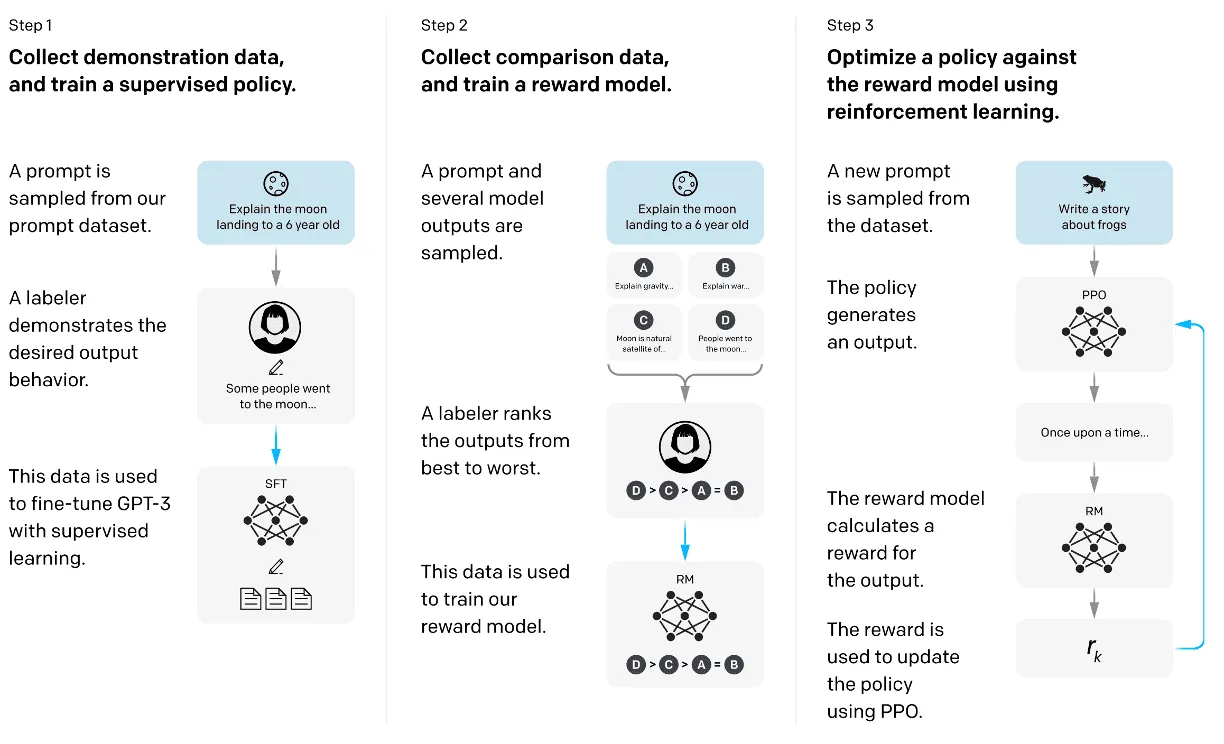

2022 年底,OpenAI 推出了 ChatGPT——一个基于 GPT 模型构建的交互式聊天机器人,该模型使用 RLHF(Reinforcement Learning from Human Feedback——基于人类反馈的强化学习)技术进行训练。这使得创建一个能够进行有意义的对话并适应用户请求的系统成为可能。

ChatGPT 成为一种文化现象,在几天内获得了数百万用户。有史以来第一次,强大的 AI 通过简单的聊天界面向公众开放。人们使用它来编写文本、解决问题、学习语言、获得建议和实现许多其他目标。

重要的是要理解,ChatGPT 不是真正的“人工智能体”,而更像是一种语言模型或助手。它无法独立设定目标、做出独立决策或在没有人工指导的情况下在现实世界中行动。ChatGPT 的工作方式类似于需要人工指导的“副驾驶”或助手。

AI Agents:新一代人工智能(2023 年及以后)

虽然像 ChatGPT 这样的语言模型彻底改变了人与 AI 交互的界面,但下一步是开发真正的 AI Agents——能够自主行动的系统。

真正的 AI Agents 具有许多关键特征,这些特征使它们与普通的语言模型区分开来:

- 能够独立设定目标并规划实现目标的途径

- 能够自主做出决策,而无需持续的人工输入

- 具有基于过去交互进行学习的记忆

- 与外部系统和数据源集成

现代 AI Agents 可以与各种工具和 API 交互、规划复杂的多步骤操作并适应不断变化的环境。它们能够在后台工作,执行分配的任务并在完成后报告结果。

此类系统的示例包括 AutoGPT、AgentGPT 和其他项目,这些项目展示了将语言模型与自主行为和与外部世界交互的能力相结合的潜力。

结论:站在巨人的肩膀上

现代 AI Agents 站在巨人的肩膀上——人工智能领域数十年研究和开发的成果。从神经网络的第一个理论模型到革命性的 Transformer 架构,从原始的感知器到超强大的 GPT 模型——每一步对于创建我们今天使用的系统都至关重要。

AI Agents 的世界才刚刚开始释放其潜力。这些系统有望改变我们与技术交互的方式、自动化日常任务并帮助解决各个领域的复杂问题——从科学和医学到教育和创造力。

在接下来的章节中,我们将更详细地研究现代 AI Agents 的工作原理、它们可以解决哪些任务以及如何有效地使用它们。但在深入研究这些主题之前,重要的是要了解历史背景——通往创建这些创新系统的漫长而奇妙的道路。